A mesterséges intelligencia (MI) hallucinációinak kezelése kritikus kihívást jelent a technológia megbízhatósága szempontjából. Egy új kutatás szerint a többszintű ügynökrendszerek és a természetes nyelvi feldolgozás (NLP) alapú keretrendszerek jelentős előrelépést jelenthetnek a probléma megoldásában.

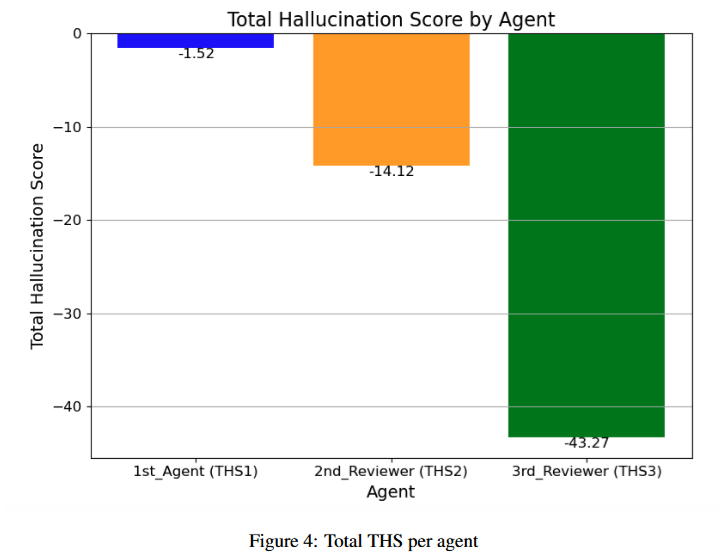

A "Hallucination Mitigation using Agentic AI Natural Language-Based Frameworks" c. tanulmányban Gosmar és Dahl egy háromszintű ügynökrendszert fejlesztettek ki, amelyben 310 speciálisan kialakított prompt (utasítás) segítségével tesztelték a hallucinációk csökkentésének hatékonyságát. Az eredmények azt mutatják, hogy a második szintű ügynök bevonásával a hallucinációs pontszám (THS) -1,52-ről -14,12-re csökkent, míg a harmadik szintű ügynök alkalmazásával -43,27-re csökkent az első szinthez képest.

A szerzők a rendszer hatékonyságát négy kulcsfontosságú teljesítménymutatóval (KPI) mérték: a tényadatok sűrűségével (Factual Claim Density - FCD), a tényszerű hivatkozások számával (Factual Grounding References - FGR), a fiktív tartalom jelzésének gyakoriságával (Fictional Disclaimer Frequency - FDF) és az explicit kontextualizációs pontszámmal (Explicit Contextualization Score - ECS).

Az eredmények rámutatnak, hogy a hallucinációk csökkentése szoros összefüggésben áll a strukturált információátadással az ügynökök között. Az OVON (Open Voice Network) keretrendszer és a strukturált adatátviteli formátumok (JSON üzenetek) kulcsszerepet játszanak ebben a folyamatban, mivel lehetővé teszik az ügynökök számára, hogy hatékonyan azonosítsák és jelezzék a potenciális hallucinációkat. Ez a megközelítés nemcsak a hallucinációs pontszámok csökkentésében bizonyult eredményesnek, hanem hozzájárult a válaszok átláthatóságának és megbízhatóságának növeléséhez is.

Források:

1.