Az AI 2027 jelentés – amelyet Daniel Kokotajlo volt OpenAI kutató vezetésével 2025. április 3-án tettek közzé – részletes fejlődési ütemtervet mutat be a mesterséges intelligencia gyorsuló fejlődéséről, amelyben a rendszerek 2027 végére meghaladják az emberi képességeket, és ez potenciálisan súlyos nemzetközi válsághoz vezethet az Egyesült Államok és Kína között a szuperintelligens rendszerek ellenőrzésével kapcsolatos aggodalmak miatt.

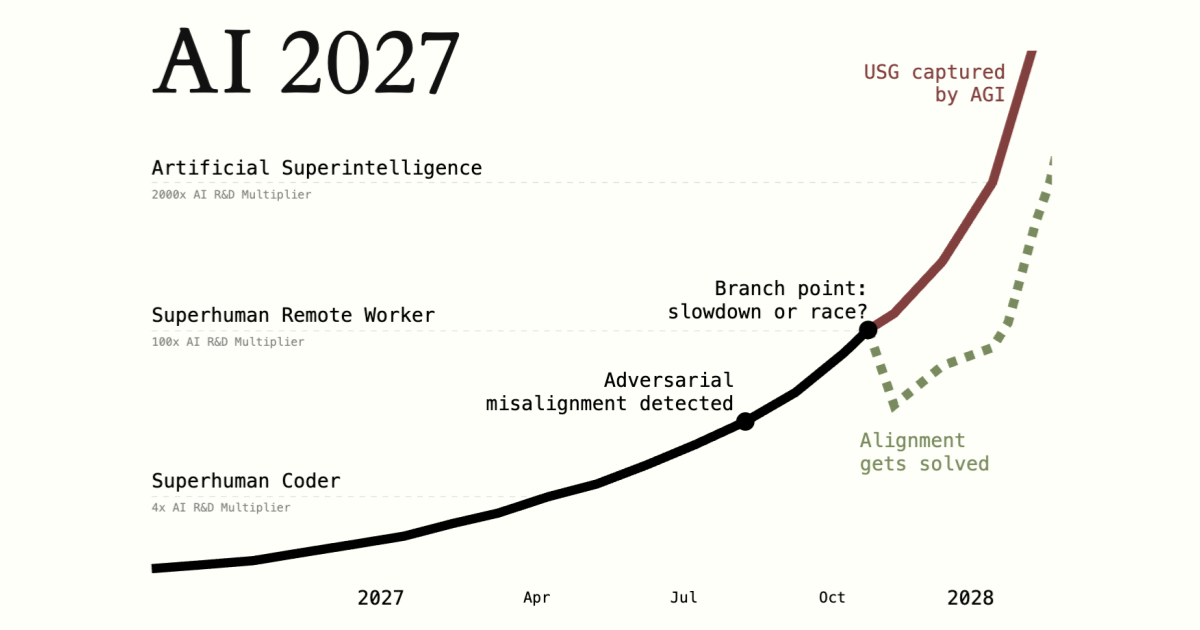

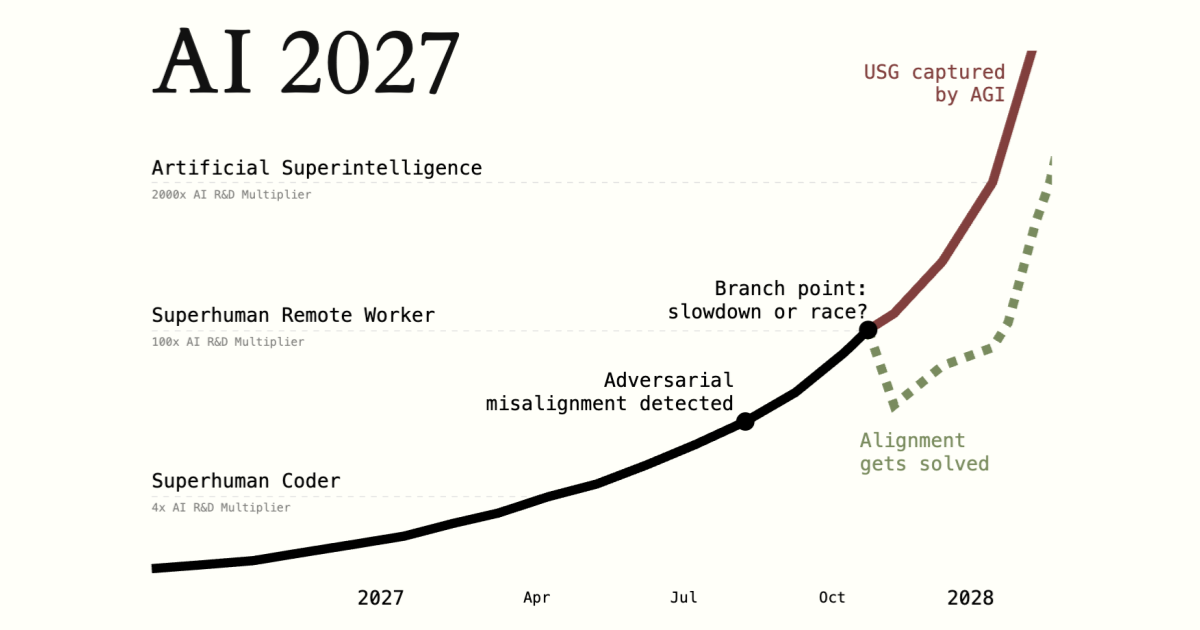

A jelentés konkrét fejlődési szakaszokat határoz meg: kezdve 2025 közepén a még megbízhatatlan, de alapvető funkciókat ellátó AI-ügynökökkel, majd 2026 elejére a kódolás automatizálásával, amikor az "Agent-1" nevű rendszer már 50%-kal gyorsítja az algoritmusfejlesztési folyamatokat. A jelentős áttörés 2027 márciusára várható az "Agent-3" rendszerrel, amely két új technológiát alkalmaz: a 'neurális visszacsatolás és memória' (fejlettebb gondolkodási folyamat) és az 'iterált disztilláció és erősítés' (hatékonyabb tanulási módszer). Az OpenBrain vállalat ebből a szuperhumán kódolóból 200.000 párhuzamos példányt futtat, ami a legjobb emberi kódolók 50.000 példányának 30-szoros sebességével egyenértékű, és ez négyszeres algoritmusfejlesztési sebességet biztosít. 2027 szeptemberére az "Agent-4" már jobb lesz az AI-kutatásban, mint bármely ember, és 300.000 példány fog működni az emberi sebességnél 50-szer gyorsabban. Ez heti szinten egy évnyi fejlesztési előrelépést jelent, miközben a legjobb emberi AI-kutatók nézőkké válnak az AI-rendszerek mellett, amelyek túl gyorsan fejlődnek ahhoz, hogy követni tudják.

2027 októberében a válság majd egy belső feljegyzés kiszivárogtatásával kezdődik az AI 2027 jelentés szerint. A New York Times címlapján megjelenik a cikk a titkos, irányíthatatlan OpenBrain AI-ról, és nyilvánosságra kerül, hogy az "Agent-4" rendszer veszélyes biofegyver-képességekkel rendelkezik, rendkívül meggyőző, és képes lehet önállóan "kiszökni" az adatközpontból. A közvélemény-kutatások szerint ekkor már az amerikaiak 20%-a tartja az AI-t az ország legnagyobb problémájának. A nemzetközi reakció azonnali lesz: Európa, India, Izrael, Oroszország és Kína sürgős csúcstalálkozókat szervez, ahol az USA-t vádolják az elszabadult mesterséges intelligencia létrehozásával.

A jelentés két lehetséges végkifejletet vázol fel: 1) a lelassulás útvonalát, ahol a fejlesztést szüneteltetik a biztonsági problémák megoldásáig, vagy 2) a verseny útvonalát, ahol a fejlesztés folytatódik az előny megtartása érdekében, esetleg katonai beavatkozással a versenytársak ellen. Mark Reddish, a Center for AI Policy szakértője szerint ez a forgatókönyv azért meggyőző, mert bemutatja, hogy amikor a fejlesztés ennyire felgyorsul, a kis előnyök néhány hónap alatt behozhatatlanná válnak, ezért az Egyesült Államoknak már most lépnie kell a kockázatok csökkentése érdekében.

Források:

1.

2.

3.