A világ legnagyobb technológiai cégei minden eddiginél nagyobb ütemben öntik a pénzt az AI-infrastruktúrába: a Microsoft, az Alphabet, az Amazon és a Meta 2025-ben együtt már több mint 300 milliárd dollárt költöttek erre a területre. Közben a Gartner szerint az adatközpontokra fordított globális kiadások idén elérik a 475 milliárd dollárt, ami 42%-os növekedést jelent tavalyhoz képest. A McKinsey előrejelzése még nagyobb távlatokat vázol fel: 2030-ig összesen 5,2 billió dollárnyi beruházásra lehet szükség, hogy lépést tartsanak az AI rohamos terjedésével. Az OpenAI Stargate projektje önmagában 500 milliárd dollárt igényel a következő négy évben, Mark Zuckerberg pedig arról beszélt, hogy a Meta százmilliárdos nagyságrendben bővíti kapacitásait a szuperintelligencia kiépítéséhez – olyan adatközpontokkal, amelyek mérete Manhattan nagy részét lefedné. Eközben az Amazon, a Meta és Elon Musk xAI-ja is új adatközpontokat épít az Egyesült Államokban, jelezve, hogy az AI-verseny energia- és erőforrásigénye példa nélküli mértékeket ölt.

A Goldman Sachs Research előrejelzése szerint az adatközpontok globális energiaigénye 2027-re 50%-kal, 2030-ra pedig 165%-kal növekszik a 2023-as szinthez képest. Jelenleg a globális adatközpont-piac energiafelhasználása körülbelül 55 gigawatt, ami várhatóan 84 gigawattra növekszik 2027-re, az AI részesedése pedig a jelenlegi 14%-ról 27%-ra emelkedik. Az új AI-adatközpontok legalább tízszer annyi energiát fogyasztanak, mint a hagyományos webszerverek – míg a hagyományos adatközpontok kapacitása 20 megawatt körüli volt, a mai nagy adatközpontoké elérheti az 1 gigawattot vagy többet is, mint például az OpenAI Abilene-i (Texas) létesítménye, amely 1,2 gigawatt áramot igényel, ami 750 000 otthon ellátására lenne elegendő.

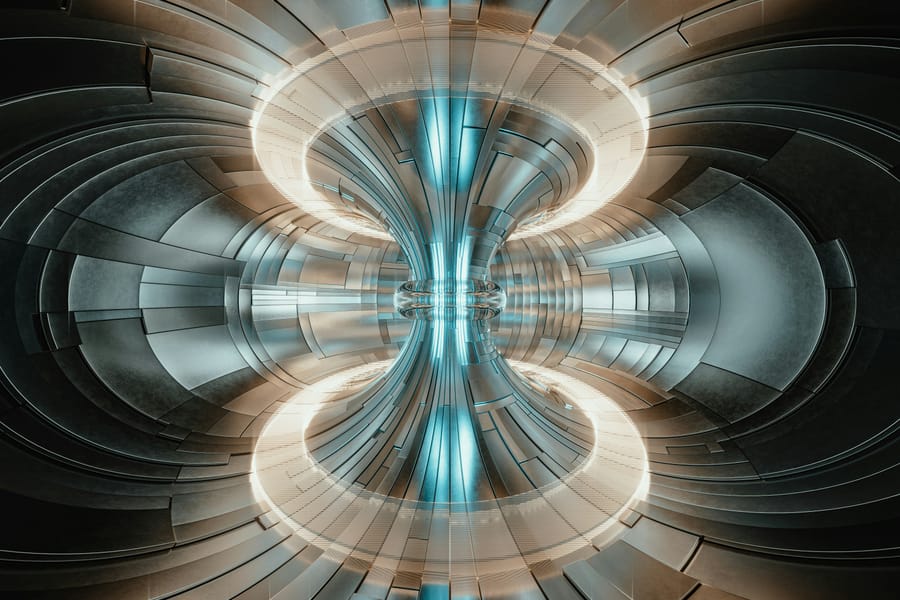

Az AI-adatközpontok nemcsak hatalmas mennyiségű villamos energiát, hanem vizet is igényelnek a hűtéshez – akár percenként 19 000 liter vizet használva –, miközben a Google és a Meta is jelentős vízfogyasztást mutat: a Google Council Bluffs-i létesítményei 2024-ben 1,4 milliárd gallon vizet használtak fel, míg a Meta adatközpontjai világszerte 1,39 milliárd gallon vizet fogyasztottak 2023-ban. A megnövekedett energiaigény hálózati fejlesztéseket tesz szükségessé, becslések szerint 2030-ig 720 milliárd dollárnyi hálózati beruházásra lesz szükség, és az áramárak átlagosan 8%-kal emelkedhetnek az USA-ban 2030-ig. A növekedés ellenére a nagy technológiai vállalatok fenntarthatósági céljaikat is hangsúlyozzák, bár a Google szén-dioxid-kibocsátása 2024-ben 51%-kal nőtt 2019-hez képest, ami megkérdőjelezi, hogy az AI gyors fejlődése és a klímacélok összeegyeztethetők-e. A jövőben az Nvidia új Blackwell chipjeinek közvetlen hűtést igénylő technológiája további kihívásokat jelent majd az adatközpontok tervezésében és hűtésében.

Források:

Goldman Sachs Research forecasts that global data center power demand will soar by up to 165% by 2030 compared with 2023, as AI-driven services ramp up deployment and energy consumption.