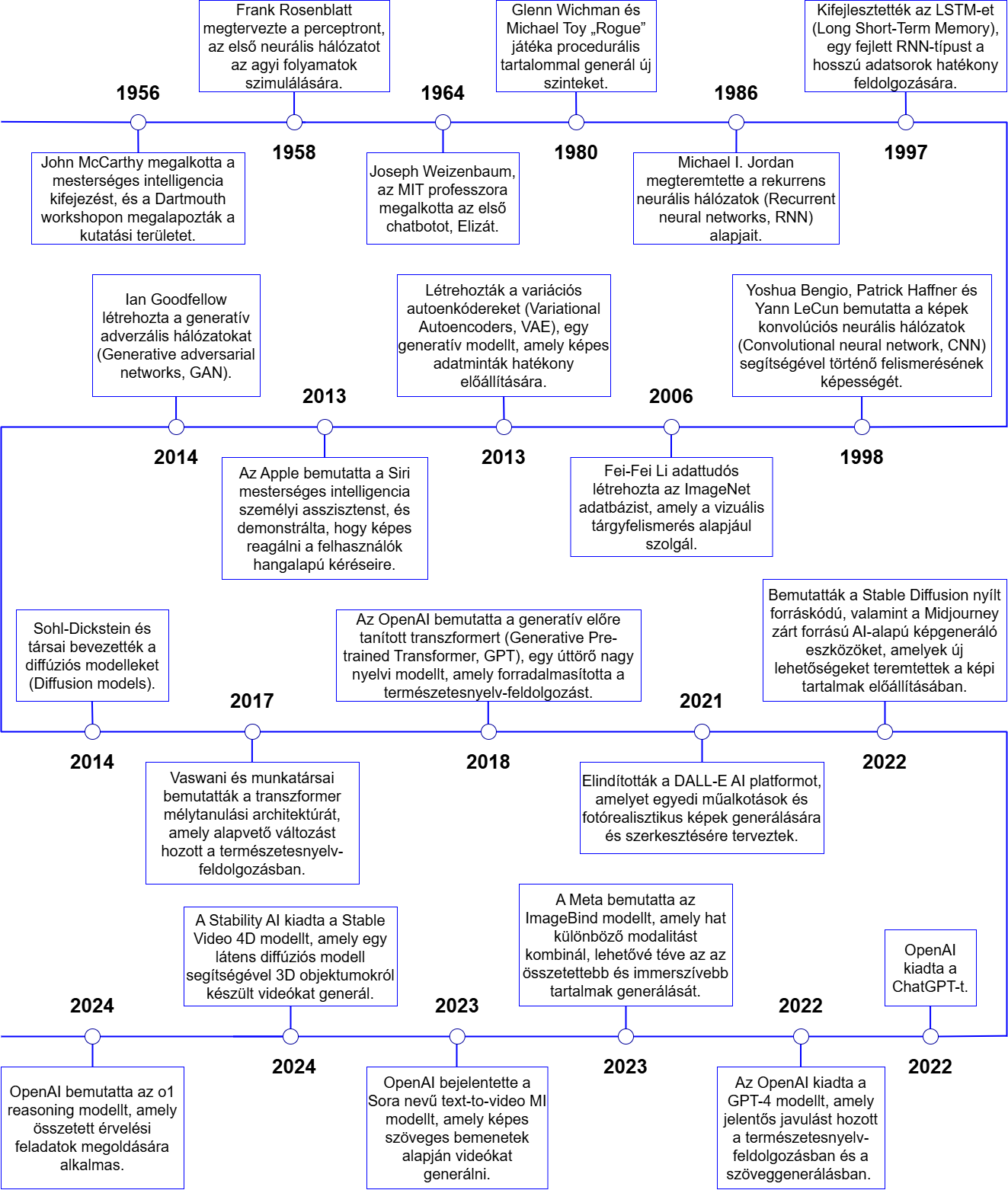

A generatív mesterséges intelligencia (GenAI) fogalma már évek óta használatos, de csak a 2010-es évek közepén-végén vált széles körben ismertté, az MI fejlődése ekkor jelentős mérföldköveket ért el, amelyek alapjaiban változtatták meg a technológia alkalmazási lehetőségeit. Az évtized elején a gépi tanulás (Machine Learning, ML) és a mesterséges neurális hálózatok (Artificial Neural Network, ANN) terén bekövetkezett áttörések (LeCun, Bengio, & Hinton 2015) új távlatokat nyitottak a számítógépes látás (Computer Vision) (Krizhevsky, Sutskever, & Hinton 2013) és a természetesnyelv-feldolgozás (Natural Language Processing, NLP) (Vaswani et al. 2017) számára. Bill Gates, a Microsoft alapítója szerint ezek az eszközök a legfontosabb technológiai előrelépést jelentik a grafikus felhasználói felület 1980-as megjelenése óta (Gates 2023).

Az áttörés egyik első mérföldköve Ian Goodfellow 2014-ben bemutatott generatív versengő hálózata (Goodfellow et al. 2014), amely lehetővé tette, hogy a meglévő mintákból kiindulva a modellek új adatokat generáljanak, például valósághű képeket. 2017-ben a Google kutatói Ashish Vaswani (2017) vezetésével bemutatták a Transzformátor architektúrát (Transformers), amely alapvetően alakította át a természetesnyelv-feldolgozás és a generatív technológiák világát. A transzformátor, amely önfigyelem (attention) mechanizmusokra épül, megszüntette a korábbi rekurrens neurális hálózatok (Recurrent neural networks, RNN, Mikolov et al. 2013) korlátait, és hatékonyabbá, gyorsabbá tette az információk feldolgozását és előállítását. Ez az innováció képezte alapját a generatív nyelvi modellek, például a GPT-sorozat későbbi fejlődésének.

2018-ban az OpenAI bemutatta a generatív előképzett transzformátort (Generative Pre-trained Transformer, GPT), egy olyan nyelvi modellt, amely rendkívül kiterjedt és sokrétű szöveges adatállományon történő tanulással képes volt bonyolult nyelvi struktúrák és mintázatok felismerésére, valamint koherens, új szövegek létrehozására (Radford et al. 2018). Ezt a mérföldkőnek számító fejlesztést 2019-ben a GPT-2 modell követte, amely már több milliárd paraméterrel rendelkezett és olyan kifinomult szövegek generálására volt képes, amelyek szinte megkülönböztethetetlenek az emberi kéz által alkotott tartalmaktól (Radford et al. 2019).

A generatív MI technológiák a 2020-as évektől váltak igazán széles körben elérhetővé, meghatározva az MI gyakorlati alkalmazásainak új korszakát. 2022 augusztusában bemutatták a Stable Diffusiont, amely szöveges leírások alapján képes valósághű és kreatív képek generálására (Rombach et al. 2022), illetve 2022 novemberében megjelent a ChatGPT, egy interaktív nyelvi modell, amely valós idejű kommunikációra képes, szöveges válaszokat generálva a felhasználók kérdéseire vagy utasításaira (OpenAI 2022). A chatbot természetesnyelv-feldolgozási képességei lehetővé teszik, hogy összetett kérdésekre adjon választ, kreatív szövegeket hozzon létre vagy kódokat generáljon, ezzel forradalmasítva a generatív MI alkalmazását. (A generatív MI fejlődésének főbb mérföldköveit az alábbi ábra foglalja össze.)

Az OpenAI GPT-4 modelljének megjelenése (OpenAI 2023a) és a hozzá kapcsolódó új funkciók – például a böngészőpluginok (OpenAI 2023b) és harmadik felek által fejlesztett kiegészítők (custom GPT) – tovább bővítették a generatív MI alkalmazási lehetőségeit. A ChatGPT az egyik legdinamikusabban fejlődő fogyasztói alkalmazássá vált, mindössze 5 nappal a 2022 novemberi indulása után 1 millió felhasználót szerzett (Brockman 2022). A legfrissebb, 2024. decemberi adatok szerint pedig már heti 300 millió aktív felhasználója van (OpenAI Newsroom 2024). A generatív versengő hálózatok, a transzformer architektúrák és a GPT-modellek által meghatározott fejlődési ív olyan generatív rendszereket eredményezett, amelyek mára a kreatív iparágaktól a tudományos kutatásig szinte minden területen alkalmazhatók.

Felhasznált irodalom:

1. Brockman, Greg. 2022. ‘ChatGPT Just Crossed 1 Million Users; It’s Been 5 Days since Launch.’ X. https://x.com/gdb/status/1599683104142430208 – ^ Vissza

2. Gates, Bill. 2023. ‘The Age of AI Has Begun’. GatesNotes. 21. – https://www.gatesnotes.com/The-Age-of-AI-Has-Begun – ^ Vissza

3. Goodfellow, Ian J., Jean Pouget-Abadie, Mehdi Mirza, Bing Xu, David Warde-Farley, Sherjil Ozair, Aaron Courville, and Yoshua Bengio. 2014. ‘Generative Adversarial Networks’. arXiv. doi:10.48550/ARXIV.1406.2661 – ^ Vissza

4. Krizhevsky, Alex, Ilya Sutskever, and Geoffrey E. Hinton. 2013. ‘ImageNet Classification with Deep Convolutional Neural Networks’. Advances in Neural Information Processing Systems 25: 26th Annual Conference on Neural Information Processing Systems 2012; December 3 - 6, 2012, Lake Tahoe, Nevada, USA, 1–9. – ^ Vissza

5. LeCun, Yann, Yoshua Bengio, and Geoffrey Hinton. 2015. ‘Deep Learning’. Nature 521 (7553): 436–44. doi:10.1038/nature14539 ^ Vissza

6. Mikolov, Tomas, Ilya Sutskever, Kai Chen, Greg Corrado, and Jeffrey Dean. 2013. ‘Distributed Representations of Words and Phrases and Their Compositionality’. arXiv. doi:10.48550/ARXIV.1310.4546 – ^ Vissza

7. OpenAI. 2022. ‘Introducing ChatGPT’. https://openai.com/index/chatgpt/ – ^ Vissza

8. OpenAI. 2023a. ‘GPT-4 Technical Report’. Download PDF – ^ Vissza

9. OpenAI. 2023b. ‘GPT-4 Technical Report’. Download PDF – ^ Vissza

10. OpenAI Newsroom. 2024. ‘Fresh Numbers Shared by @sama Earlier Today’. X. 04. https://x.com/OpenAINewsroom/status/1864373399218475440 – ^ Vissza

11. Radford, Alec, Karthik Narasimhan, Tim Salimans, and Ilya Sutskever. 2018. ‘Improving Language Understanding by Generative Pre-Training’. Download PDF – ^ Vissza

12. Radford, Alec, Jeffrey Wu, Rewon Child, David Luan, Dario Amodei, and Ilya Sutskever. 2019. ‘Language Models Are Unsupervised Multitask Learners’. Download PDF – ^ Vissza

13. Rombach, Robin, Andreas Blattmann, Dominik Lorenz, Patrick Esser, and Björn Ommer. 2022. ‘High-Resolution Image Synthesis with Latent Diffusion Models’. arXiv. doi:10.48550/ARXIV.2112.10752 – ^ Vissza

14. Vaswani, Ashish, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan N. Gomez, Lukasz Kaiser, and Illia Polosukhin. 2017. ‘Attention Is All You Need’. arXiv. doi:10.48550/ARXIV.1706.03762 – ^ Vissza